Brojne tvrtke uključujući Microsoft і Facebook, pa čak i istraživači sa Sveučilišta Južne Kalifornije, razvijaju tehnologije za borbu protiv deepfakeova i sprječavaju njihovo širenje žutim medijima i dezinformacijama općenito. No, grupa znanstvenika ipak ih je uspjela prevariti.

Tim računalnih znanstvenika sa Sveučilišta Kalifornija u San Diegu upozorio je da je još uvijek moguće prevariti postojeće sustave za otkrivanje deepfakea umetanjem ulaznih podataka koji se nazivaju "konkurentnim primjerima" u svaki video okvir. Znanstvenici su svoja otkrića predstavili na WACV 2021 Computer Vision konferenciji, održanoj online prošlog mjeseca.

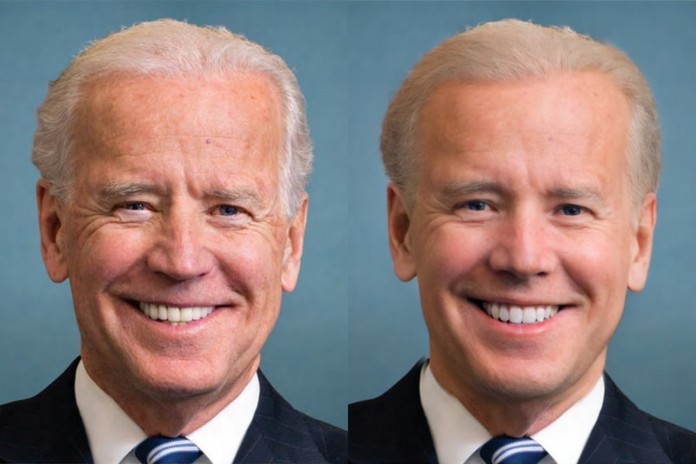

Konkurentski primjeri su malo izmijenjeni ulazi koji uzrokuju pogreške u sustavima umjetne inteligencije, poput modela strojnog učenja. Osim toga, tim je pokazao da napad i dalje radi nakon komprimiranja videa. U videu iznad, znanstvenici pokazuju da XceptionNet, detektor deepfakea, označava njihov konkurentski video kao "pravi".

Većina tih detektora radi tako da prati lica u videu i šalje podatke o izrezanom licu neuronskoj mreži na analizu. Neuronska mreža će zatim analizirati te podatke i pronaći elemente koji se obično loše reproduciraju u deepfakeovima, kao što je treperenje.

Umetanjem konkurentskih primjera, istraživači su otkrili da mogu prevariti ove detektore dubokih krivotvorina da povjeruju da su videozapisi stvarni.

U radu navode da je “kako bi se ovi detektori deepfake koristili u praksi, važno ih je procijeniti u odnosu na prilagodljivog protivnika koji je svjestan ove zaštite i namjerno je pokušava slomiti. Pokazujemo da se suvremene metode otkrivanja lažnog lažiranja mogu lako zaobići ako je napadač u potpunosti ili čak djelomično svjestan detektora."

Kao što su ovi znanstvenici pokazali, tehnologije automatizacije koje se razvijaju za borbu protiv dezinformacija možda još nisu dorasle zadatku.

Pročitajte također: